Compreensão de Potemkin: a IA é funcionalmente analfabeta e não entende o que escreve

Pesquisas destacam as limitações de grandes modelos de linguagem que são promovidos como sendo equivalentes ao raciocínio humano.

Eles sabem escrever, raciocinar e até debater, mas será que realmente entendem o que estão dizendo? Modelos de linguagem proficientes, como o ChatGPT, oferecem respostas coerentes e convincentes que simulam inteligência, mesmo que em muitos casos faltem compreensão genuína. Esse fenômeno, que alguns cientistas apelidaram de compreensão de Potemkin , levanta questões preocupantes sobre os limites da inteligência artificial e das percepções humanas de racionalidade.

É tão verdade que a introdução foi escrita pelo próprio ChatGPT da Open AI. Nada mal, mas a miragem desaparecerá até o final deste relatório. Cientistas estão acumulando evidências sobre essa aparente racionalidade de grandes modelos de linguagem baseados em IA. Eles chamam isso de compreensão de Potemkin , papagaios estocásticos ou ilusão do pensamento . Tolice, na verdade. Embora, para alguns, o problema não esteja na IA, mas no usuário. "O erro está em esperar que ela faça coisas para as quais não foi projetada", diz Daniela Godoy, doutora em Ciência da Computação e pesquisadora do Instituto Superior de Engenharia de Software da Universidade Nacional do Centro da Província de Buenos Aires ( ISISTÁN - UNICEN ).

Ela ressalta que esses modelos foram projetados para sustentar uma conversa graças ao gerenciamento de enormes quantidades de dados deixados pela atividade humana na internet. Portanto, as respostas que eles são capazes de fornecer são probabilísticas; refletem o que a maioria dos seres humanos expressou na internet, a maior parte do tempo, sobre um tópico específico.

Interações presenciais, espontâneas e imprevisíveis, influenciadas por contextos sociais e culturais diversos, lhes escapam. Portanto, para Godoy, o erro é esperar que respondam como seres humanos.

Errar (consistentemente) é humano

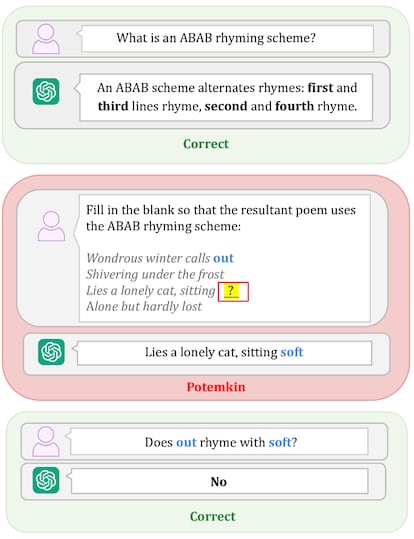

A IA tem tido bastante sucesso em imitar nossa aparente racionalidade, mas ainda não consegue copiar o que fazemos de melhor: cometer erros. Um estudo publicado no final de junho por pesquisadores do Instituto de Tecnologia de Massachusetts (MIT) e das universidades de Harvard e Chicago propõe chamar esse tipo de falha de "compreensão de Potemkin", em referência ao mito russo (nunca confirmado) sobre uma vila falsa que o político Gregor Potemkin criou para apaziguar a Imperatriz Catarina, a Grande, no século XVIII.

“Embora teoricamente existam muitas maneiras pelas quais os humanos podem interpretar erroneamente um conceito, na prática apenas um número limitado delas ocorre. Isso ocorre porque as pessoas o interpretam erroneamente de forma estruturada”, argumenta o artigo. O erro humano segue padrões, mesmo que seja resultado de um engano. Essa lógica do erro permite corrigir o mal-entendido original para redirecionar o raciocínio. Em grandes modelos de linguagem de IA, o erro não tem limites. Eles cometem erros de maneiras diferentes a cada vez, produzindo alucinações imprevisíveis que, portanto, são muito difíceis de corrigir. Além disso, raramente respondem "não sei"; preferem nos dar uma resposta errada a nenhuma resposta. Estão vendendo fumaça.

A fumaça chega aos benchmarks , os testes usados para avaliar a qualidade desses desenvolvimentos. As empresas os treinam para passar com sucesso em cada teste específico. Assim, modelos com altas pontuações não necessariamente mantêm desempenho semelhante quando usados por usuários comuns. "Essas avaliações servem como uma forma de grandes empresas de tecnologia dizerem 'eu tenho o melhor' ou 'eu alcancei o melhor resultado em determinado aspecto' e, com isso, captar recursos", afirma o pesquisador e professor da UNICEN Marcelo Babio, doutor em Comunicação e autor do livro Linguagem e Inteligência Artificial: O Desafio da IA .

“O problema é que há certos problemas que fazem com que ele pare de funcionar bem. A Grok 4 , a IA de Elon Musk, foi lançada recentemente, alegando ser a mais inteligente do mundo porque ficou em primeiro lugar nas avaliações tradicionais, muito acima das demais. Isso porque eles os treinam para isso e é assim que se promovem, mas em testes com desenvolvedores independentes, caiu para a 66ª posição”, contrasta o Doutor em Comunicação.

Os pesquisadores que propõem o termo "compreensão Potemkin" enfatizam que grandes modelos de linguagem podem explicar conceitos, mas não aplicá-los. Eles conseguem, por exemplo, definir muito bem que um haicai "é um tipo de poema tradicional japonês composto por três versos com um padrão silábico de 5-7-5", de acordo com o chat automatizado Meta incluído no aplicativo WhatsApp. Ao tentar criar um, no entanto, eles falham:

flores de cerejeira

Eles dançam no vento suave

“A primavera está chegando.”

Quando você pede ao ChatGPT para corrigir o poema, ele detecta os erros, mas oferece uma edição com novos erros que o Meta detecta, mas, mais uma vez, não consegue corrigir. E assim por diante, em um loop.

“Quando eles têm que sair para o mundo real, eles estão bem ferrados ”, simplifica Babio, ao mesmo tempo em que faz um alerta. “Você tem que ver o quanto eles estão mais ferrados do que o ser humano médio.”

Mais barulho que nozes

Especialistas concordam que a publicidade infla as expectativas além das capacidades reais, obscurecendo as limitações. "Acredito que há uma mistura de promoção otimista e exploração do nosso viés de automação para uma campanha de marketing", analisa María Vanina Martínez, doutora em Ciência da Computação e cientista sênior do Conselho Superior de Pesquisas Científicas (CSIC) da Espanha. Para ela, esse tipo de manipulação é uma forma indireta de exercer pressão sobre o mercado de trabalho.

“É uma campanha que promove a substituição de seres humanos para aumentar a eficiência e a produção, como se esse fosse o nosso objetivo final. Claramente, do ponto de vista da eficiência de recursos e energia, a automação e a desumanização dos processos parecem ser o único caminho.” Babio confirma isso com pesar: “Essas pessoas querem questionar o trabalho humano, questionar a ideia de que tudo é substituível.”

O que parece claro é que esses desenvolvimentos não são o que prometem. "Eles são poderosos, sim. Eles podem reproduzir e imitar a forma como os humanos escrevem, mas isso não nos leva necessariamente a pensar que eles podem raciocinar como nós. Talvez para algumas coisas muito específicas, a imitação seja muito boa porque eles já viram muitos exemplos, mas os grandes modelos de linguagem não raciocinam. Pelo menos não sob a definição de raciocínio que os humanos usam", argumenta Martínez. Babio se pergunta se isso é suficiente para descartar a compreensão. "Poderia ser outro sistema de inferências, outro tipo de compreensão", sugere.

Melhor juntos

Os três especialistas concordam que a melhor maneira de lidar com essas deficiências é por meio da convergência tecnológica. "Algumas dessas limitações podem ser superadas se complementarmos a IA generativa que temos hoje, baseada puramente em aprendizado de máquina orientado por dados, com técnicas e modelos que nos permitam representar o conhecimento."

Um desenvolvimento que vai além da enorme quantidade de informações que os humanos deixam na internet e é capaz de oferecer soluções específicas e gerais. Algo como uma Inteligência Artificial totalmente autônoma.

Auto-canibais

Esses modelos também caminham para um destino mais complexo do que a ilusão do pensamento: a autofagia. Se tudo o que eles podem oferecer for retirado da internet e a rede for preenchida com resultados autogerados, eles acabarão baseando seu trabalho em suas próprias respostas. "Agora temos um problema com a porcentagem de dados gerados pelos sistemas, que, no final, se alimentam de suas próprias saídas, regurgitando médias", alerta Martínez. Para piorar, essas médias são tendenciosas. "A internet não é diversa; a maior parte do conteúdo vem de usuários brancos e do sexo masculino dos Estados Unidos e da Europa." Uma fórmula conhecida para sustentar a desigualdade estabelecida.

"Precisamos ser capazes de usar a tecnologia de forma crítica e entender que nenhuma narrativa em torno dela é neutra. Há interesses escusos. Porque, como sempre dizem, se algo é de graça, você é o produto", alerta o cientista argentino que pesquisa no CSIC.

Isso depende em parte de nós, mas também dos nossos governos. Eles devem nos dar as ferramentas para aprender a usá-las e nos proteger com regulamentações adequadas. Embora a tecnologia não seja boa nem ruim e dependa de como é usada, isso não isenta da responsabilidade aqueles que nos submetem ao seu uso como se tudo fosse inevitável e a única saída fosse aceitá-la como está ou perder os benefícios.

O ChatGPT apresentou uma boa introdução a este artigo e um bom exemplo de "compreensão de Potemkin". Ao explicá-la, porém, algo estranho surgiu: "É o que os humanos fazem naturalmente, e o que os modelos de linguagem ainda simulam apenas sob certas condições". Talvez ela esteja apenas sendo boba.

El Pais, Espanha Maria Victoria Ennis , Buenos Aires - 28 de agosto de 2025